分布式数据处理系统 构建高效数据处理服务的核心架构

在当今大数据时代,数据已成为驱动企业决策和创新的关键资产。为了应对海量、多样、实时的数据处理需求,传统的集中式数据处理架构已显得力不从心。分布式数据处理系统应运而生,它通过将计算任务和数据存储分散到多台计算机节点上协同工作,不仅显著提升了处理能力,还增强了系统的可扩展性和容错性。本文将探讨分布式数据处理系统的核心概念、数据处理服务的关键组件,以及如何构建一个稳健高效的数据处理服务体系。

一、 分布式数据处理系统的核心概念

分布式数据处理系统的核心在于“分而治之”。它将一个庞大的数据集或复杂的计算任务分解成多个子集或子任务,并将其分配到网络中的多个计算节点(通常称为集群)上并行执行。这些节点协同工作,共同完成最终的计算目标。其核心优势体现在:

- 高可扩展性:通过简单地增加节点,即可线性或近似线性地提升系统的存储容量和处理能力,轻松应对数据量的增长。

- 高容错性:单个或多个节点故障不会导致整个系统瘫痪,数据通常有多个副本,任务可以被重新调度到其他健康节点执行。

- 高并发与高性能:并行处理机制使得系统能够同时处理大量请求和计算任务,极大缩短了数据处理周期。

- 成本效益:可以利用廉价的商用硬件构建大规模集群,相比大型专用服务器,总拥有成本更低。

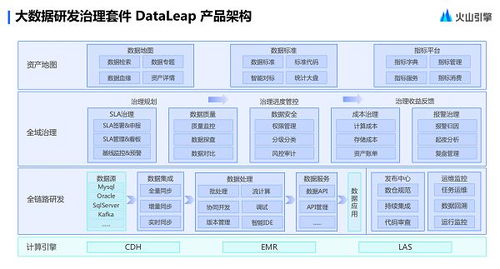

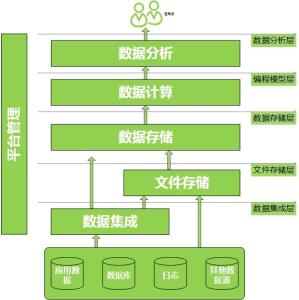

二、 数据处理服务的关键组件与架构

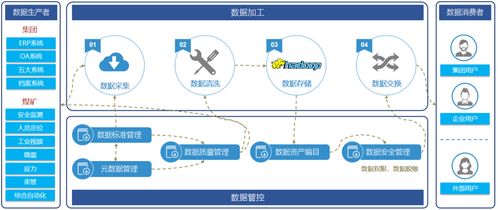

一个完整的分布式数据处理服务通常由以下几层关键组件构成:

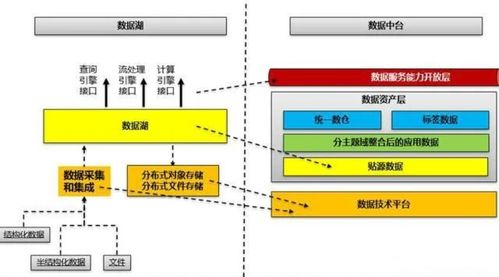

- 数据存储层:这是系统的基石。典型的分布式存储系统如HDFS、Amazon S3、Google Cloud Storage等,它们将文件块分散存储在不同的节点上,并提供高吞吐量的数据访问能力。NoSQL数据库(如HBase、Cassandra)和NewSQL数据库也在此列,为结构化或半结构化数据提供分布式存储与查询。

- 资源管理与调度层:负责整个集群资源的抽象、管理和分配。YARN和Kubernetes是这一层的杰出代表。它们将CPU、内存、磁盘等物理资源池化,并根据上层计算框架的需求进行动态调度,确保资源的高效利用和任务的顺利执行。

- 计算引擎层:这是执行数据处理逻辑的核心。根据处理模式的不同,可以分为:

- 批处理引擎:如Apache Spark、Apache Flink(也支持流处理)、MapReduce。它们擅长处理静态的、历史的海量数据集,进行复杂的ETL、分析和机器学习训练。

- 流处理引擎:如Apache Flink、Apache Storm、Spark Streaming。它们专为处理无界数据流设计,能够实现低延迟的实时计算、监控和预警。

- 交互式查询引擎:如Presto、Apache Impala。它们允许用户使用SQL或类似语言对海量数据进行亚秒级到秒级的交互式查询。

- 数据编排与服务层:这一层负责数据治理、工作流编排和对外提供统一的数据服务。工具如Apache Airflow用于编排复杂的数据管道;数据目录和元数据管理工具(如Apache Atlas)帮助追踪数据血缘和治理;而通过API网关和微服务,可以将处理后的数据以安全、标准化的方式提供给下游应用和用户。

三、 构建稳健高效的数据处理服务

构建一个面向生产的分布式数据处理服务,需要综合考虑以下几个方面:

- 明确需求与选型:首先需明确业务场景是批处理、流处理还是混合负载。根据对延迟、吞吐量、一致性级别的要求,选择合适的存储和计算组件组合。例如,对实时性要求极高的场景,Flink可能是比Spark Streaming更佳的选择。

- 设计弹性与容错架构:在架构设计之初就需考虑故障恢复。包括数据的多副本策略、计算任务的检查点(Checkpointing)和状态备份、服务的无状态设计以及自动化的故障转移机制。

- 保障数据质量与一致性:实施端到端的数据质量监控,确保数据在采集、处理、存储各个环节的准确性和完整性。对于需要强一致性的场景,需仔细设计数据写入和读取模式。

- 实现可观测性与运维:建立完善的监控体系,涵盖集群资源利用率、作业运行状态、数据管道延迟、错误率等关键指标。结合日志聚合和告警系统,实现问题的快速发现与定位,保障服务SLA。

- 注重安全与治理:实施基于角色的访问控制,对敏感数据进行加密(传输中和静止时),并建立全面的数据血缘和生命周期管理策略,满足合规性要求。

###

分布式数据处理系统及其服务已成为现代数据基础设施的中枢神经。它通过将分散的资源整合成强大的统一计算能力,使得从海量数据中快速提取价值成为可能。随着云原生、Serverless和AI驱动的自动化运维等技术的发展,未来的数据处理服务将更加智能、弹性且易于管理,持续赋能企业数字化转型与智能化升级。成功的关键在于深入理解核心原理,并基于实际的业务需求,精心设计和持续优化整个技术栈。

如若转载,请注明出处:http://www.jxfreespace.com/product/14.html

更新时间:2026-06-02 23:10:16